Les États parties à la Convention sur certaines Armes Classiques (CCW) s'épuisent à débattre des questions liées aux technologies émergentes dans le domaine des systèmes d’armes létales autonomes. Depuis mai 2014. Cependant, aucun accord n’a encore été trouvé à propos d’une éventuelle interdiction des robots-tueurs, laissant libre cours aux industriels qui développent ces armes.

Les États parties à la Convention sur certaines Armes Classiques (CCW) s'épuisent à débattre des questions liées aux technologies émergentes dans le domaine des systèmes d’armes létales autonomes. Depuis mai 2014. Cependant, aucun accord n’a encore été trouvé à propos d’une éventuelle interdiction des robots-tueurs, laissant libre cours aux industriels qui développent ces armes.

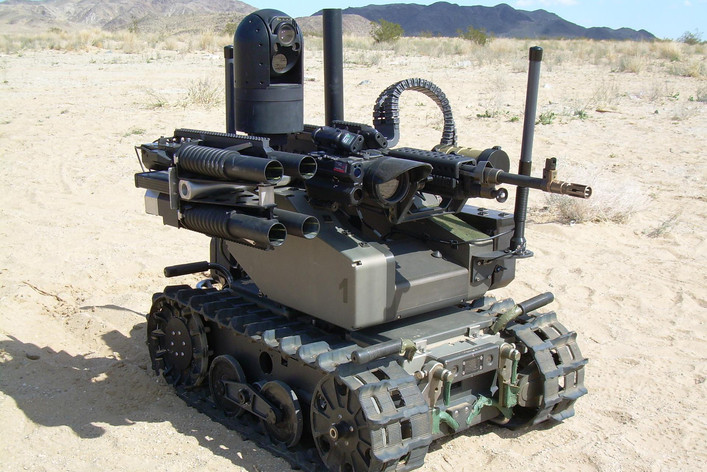

De fait, des armes de plus en plus autonomes préfigurant des robots tueurs existent déjà. On les retrouve dans les catégories suivantes : systèmes de défense aérienne, systèmes de protection active, robots sentinelles antipersonnel, munitions guidées et munitions rodeuses...Parler de ‘technologies en plein développement’ signifie que d’autres verront probablement le jour.

Les principaux pays qui développent ou produisent ces armes sont la Chine, la Corée du Sud, les États-Unis et la Russie. À ces quatre États, il convient d’ajouter, dans une moindre mesure, l’Allemagne, l’Australie, l’Estonie, la France, l’Inde, Israël, l’Italie, le Japon, la Norvège, la Pologne, Singapour, la Suède, le Royaume-Uni, la Turquie, ainsi que Taiwan.

Déjà à la manoeuvre

Un des premiers échantillons de ces productions est le robot-sentinelle antipersonnel SGR-A1 développé dans les années 2000 par la firme Samsung Techwin (devenue en 2015 Hanwha Techwin. Comme l’écrivait le GRIP dès 2017, ce robot-sentinelle équipé de caméras, de microphones, de haut-parleurs et d’une mitrailleuse est doté d’un mode de sélection et de traitement des cibles automatiques. Selon BBC News, la mitrailleuse du SGR-A1 peut être commutée en mode autonome mais… est actuellement exploitée par des humains via des liaisons caméra.

Un des premiers échantillons de ces productions est le robot-sentinelle antipersonnel SGR-A1 développé dans les années 2000 par la firme Samsung Techwin (devenue en 2015 Hanwha Techwin. Comme l’écrivait le GRIP dès 2017, ce robot-sentinelle équipé de caméras, de microphones, de haut-parleurs et d’une mitrailleuse est doté d’un mode de sélection et de traitement des cibles automatiques. Selon BBC News, la mitrailleuse du SGR-A1 peut être commutée en mode autonome mais… est actuellement exploitée par des humains via des liaisons caméra.

Un exemple plus récent est le robot terrestre Uran-9, un système robotique polyvalent de combat développé par la firme russe Kalachnikov Concern et commercialisé depuis 2016. Télécommandé à une distance de trois kilomètres et faisant usage d’intelligence artificielle , l’Uran-9 peut avancer en système automatique laissant à l’opérateur le choix des cibles . D’après Kalachnikov Concern, de nombreuses solutions scientifiques et techniques ont été élaborées [sur l’Uran-9]. Testé en Syrie, l’Uran-9 y aurait cependant perdu le contact avec la station de contrôle à 18 reprises. Selon RIA Novosti, le robot a également montré le fonctionnement instable du canon automatique de 30 mm, le déclenchement intempestif des circuits de lancement et la défaillance du canal d’imagerie thermique de la station de visée optique.

Un autre exemple est le Switchblade (littéralement le couteau à cran d’arrêt ), un missile rodeur miniature récemment commercialisé par la firme américaine AeroVironment. Dans sa version initiale, le Switchblade ne pèse que 2,5 kilogrammes et peut être rangé dans un sac à dos. Son coût serait de l’ordre de 70 000 $. Dans une version plus élaborée, une fois sur la zone cible, il peut y flâner pendant plus de 20 minutes pour identifier sa cible avant de plonger dessus. Selon l’entreprise, ce missile létal volant miniature peut être utilisé manuellement ou de manière autonome et ses versions futures pourraient sélectionner des cibles de manière autonome avec un soutien minimal de la part de l’homme dans la boucle.

Un dernier exemple est le bateau de combat sans pilote JARI actuellement développé par la firme d’État chinoise China Shipbuilding Industry Corporation. Ce bateau de 15 mètres de long est notamment équipé de missiles à lancement vertical, d’un lance-torpilles, d’une mitrailleuse et d’un lance-roquettes montés à l’avant. Sa mitrailleuse tire automatiquement sur des cibles de surface se rapprochant rapidement, et ce après des coups de semonce. Le JARI utilise l’intelligence artificielle pour naviguer de manière autonome et entreprendre des activités de combat une fois qu’il en reçoit l’ordre. Il peut opérer seul ou en essaim avec d’autres en mode autonome, semi-autonome ou commandé à distance. D’après ses développeurs, le JARI aura encore besoin de tests supplémentaires pour 'libérer tout son potentiel' en tant que drone de combat entièrement autonome.

Pourquoi interdire les robots tueurs ?

Comme le montrent les quatre exemples évoqués ci-dessus, des robots tueurs capables de sélectionner et d’attaquer des cibles de manière indépendante pourraient bientôt ne plus appartenir à la science-fiction. Le niveau de contrôle humain sur les armes autonomes décrites ici est en effet de plus en plus réduit, ouvrant progressivement la porte à des situations dans lesquelles la décision de tuer sera prise par une machine, et non plus par un être humain. Ce transfert de responsabilité de l’homme à la machine pose toute une série de problèmes, notamment d’ordre juridique et militaire.

Comme le montrent les quatre exemples évoqués ci-dessus, des robots tueurs capables de sélectionner et d’attaquer des cibles de manière indépendante pourraient bientôt ne plus appartenir à la science-fiction. Le niveau de contrôle humain sur les armes autonomes décrites ici est en effet de plus en plus réduit, ouvrant progressivement la porte à des situations dans lesquelles la décision de tuer sera prise par une machine, et non plus par un être humain. Ce transfert de responsabilité de l’homme à la machine pose toute une série de problèmes, notamment d’ordre juridique et militaire.

Un premier problème — majeur — concerne le respect du droit international humanitaire : en particulier l’obligation pour les parties en conflit de faire la distinction entre combattants et non-combattants, de garantir que les victimes civiles et les dommages causés à des installations civiles (bâtiments) ne soient pas disproportionnés par rapport aux gains militaires attendus, ainsi que de prendre les précautions nécessaires pour protéger les populations civiles. Comme le souligne le Comité International de la Croix Rouge, ces obligations ne peuvent pas être transférées à une machine. Car le respect du droit international humanitaire (DIH) nécessite une capacité d’analyse et d’empathie dont ne dispose pas un robot tueur, aussi avancé soit-il. Pour reprendre les termes du lieutenant-colonel retraité John McBride, 'une machine déterminerait si la cible est un combattant uniquement sur la base d’une programmation préalable' (!)

De plus, l’impossibilité pour un robot tueur d’être traduit en justice en cas de crime commis constitue une difficulté supplémentaire. En d’autres termes, un robot tueur pourrait frapper en toute impunité. Le risque que le recours aux robots tueurs ne facilite le déclenchement de conflits armés n'est pas à sous-estimer. D’abord parce qu’il élimine les dernières barrières psychologiques à l’utilisation de la force. Ensuite, parce qu’en réduisant le coût humain d’un conflit armé, le recours aux robots tueurs rend l’entrée en guerre plus facile et réduit l’incitation à trouver une solution politique. Comme le souligne l’organisation néerlandaise PAX, le recours à ces engins crée (également) le risque d’accélérer les courses aux armements, avec des robots tueurs qui s’affronteraient/ront à des vitesses ne permettant plus le moindre contrôle humain. Les robots tueurs étant relativement peu coûteux et faciles à copier, ils pourraient également proliférer et tomber aux mains de groupes terroristes, voire être piratés. Enfin, les interactions entre robots tueurs ennemis pourraient être très imprévisibles. Comme le fait remarquer l’ONG Human Rights Watch, 'la grande majorité des Etats qui se sont exprimés à ce jour considèrent la prise de décision, le contrôle ou le jugement humains comme essentiels à l’acceptabilité et à la légalité des systèmes d’armes'.

Le risque que le recours aux robots tueurs ne facilite le déclenchement de conflits armés n'est pas à sous-estimer. D’abord parce qu’il élimine les dernières barrières psychologiques à l’utilisation de la force. Ensuite, parce qu’en réduisant le coût humain d’un conflit armé, le recours aux robots tueurs rend l’entrée en guerre plus facile et réduit l’incitation à trouver une solution politique. Comme le souligne l’organisation néerlandaise PAX, le recours à ces engins crée (également) le risque d’accélérer les courses aux armements, avec des robots tueurs qui s’affronteraient/ront à des vitesses ne permettant plus le moindre contrôle humain. Les robots tueurs étant relativement peu coûteux et faciles à copier, ils pourraient également proliférer et tomber aux mains de groupes terroristes, voire être piratés. Enfin, les interactions entre robots tueurs ennemis pourraient être très imprévisibles. Comme le fait remarquer l’ONG Human Rights Watch, 'la grande majorité des Etats qui se sont exprimés à ce jour considèrent la prise de décision, le contrôle ou le jugement humains comme essentiels à l’acceptabilité et à la légalité des systèmes d’armes'.

Réticences, résistances et oppositions

Alors, à quand un traité sur les robots tueurs et dans quelle enceinte ?

Depuis 2013, 78 États ont déjà appelé à l’interdiction des robots tueurs, que ce soit à travers des déclarations nationales ou des déclarations de groupes. Mais une dizaine d’États (Australie, Corée du Sud, États-Unis, France, Inde, Israël, Pays-Bas, Royaume-Uni, Russie et Turquie), s’opposent à la négociation d’un traité sur les robots tueurs, qu’ils jugent ’prématurée’ . Parmi ces États, la Russie. Son représentant a expliqué ’Nous ne sommes pas favorables à un résultat concret de nos travaux’. Les États-Unis s’opposent à toute référence à la nécessité d’un contrôle humain sur l’usage de la force. Quant à la Chine, si elle a bien appelé à interdire l’utilisation des armes entièrement autonomes, son appel ne couvre pas le développement et la production de ces armes.

Dans la mesufre où les États parties à la CCW prennent leurs décisions sur la base du consensus, il est difficile d’imaginer comment un accord crédible sur les robots-tueurs pourrait se dégager dans cette enceinte. En raison de cette opposition, et du coronavirus, les discussions au sein de la Convention sur certaines armes classiques ont été reportées. Elles devraient reprendre en 2021 sous la présidence de la Belgique. Le 30 septembre 2020, le nouveau gouvernement fédéral (belge) écrivait à ce propos : ’Notre pays prendra l’initiative pour parvenir à un cadre réglementaire sur les systèmes des armes entièrement autonomes, en vue d’une interdiction internationale’. En raison des blocages persistants au sein de la CCW, la Belgique devra rapidement envisager d’autres enceintes si elle veut faire aboutir son initiative et répondre ainsi à l’appel du Secrétaire général de l’ONU à interdire ces armes qui sont ‘politiquement inacceptables et moralement révoltantes’.

Stan Brabant -Directeur adjoint du GRIP 'Eclairage' de décembre 2020.

'Eclairage' de décembre 2020.

Avec l’aimable autorisation de l’auteur - qui tient à remercier le major aviateur e. r. Lode Dewaegheneire, Solène Jomier, Yannick Quéau et Merel Selleslach pour leurs précieux commentaires.

Pour en savoir davantage : le factsheet de Pax Christi, Belgique, Campaign to Stop Killer Robots.